El Servicio Madrileño de Salud (SERMAS) será el primero en implementar la inteligencia artificial para ayudar a los médicos en España. Concretamente, hablamos de un modelo de IA generativa denominado dxGPT, desarrollado por Microsoft y Fundación 29, que servirá para diagnosticar enfermedades raras más fácilmente.

El lanzamiento de ChatGPT supuso una auténtica revolución en el ámbito tecnológico y, desde entonces, las capacidades y la rápida evolución de las herramientas de IA generativa no han dejado de sorprendernos. Como sabemos, los usuarios pueden emplearlas para infinidad de cosas, como realizar consultas, redactar textos de todo tipo o programar. Y ahora también puede beneficiar a los profesionales madrileños del ámbito sanitario.

Gracias a un acuerdo entre la Consejería de Digitalización de la Comunidad de Madrid, Microsoft y Fundación 29, los centros de atención primaria podrán utilizar dxGPT, una herramienta basada en GPT-4, para acelerar sus diagnósticos, especialmente en relación con las enfermedades raras.

“La Inteligencia Artificial utilizada con todos los estándares de responsabilidad y seguridad, está ofreciendo grandes avances para la Sanidad madrileña. Acciones como esta constatan las ventajas que las nuevas tecnologías están suponiendo para la detección precoz de enfermedades, y este valor es aún mayor en el caso de aquellas que son consideradas como raras,” explica Miguel López Valverde, consejero de Digitalización de la Comunidad de Madrid.

Un chatbot para los médicos

Y es que, a pesar de contar con muchos más medios que antes, identificar este tipo de enfermedades sigue siendo bastante complicado. Los pacientes que las sufren tardan cinco años de media en recibir un diagnóstico correcto y, en muchas ocasiones, eso implica que tengan que acudir a hasta siete especialistas distintos para dar con una respuesta acertada y precisa.

Es más. Por desgracia, como señalan los de Redmond: “más de la mitad de estos pacientes, se queda sin diagnosticar u obtienen un diagnóstico erróneo. Esto puede producir que reciban un tratamiento incorrecto que podría ser perjudicial e incluso, agravar su enfermedad.”

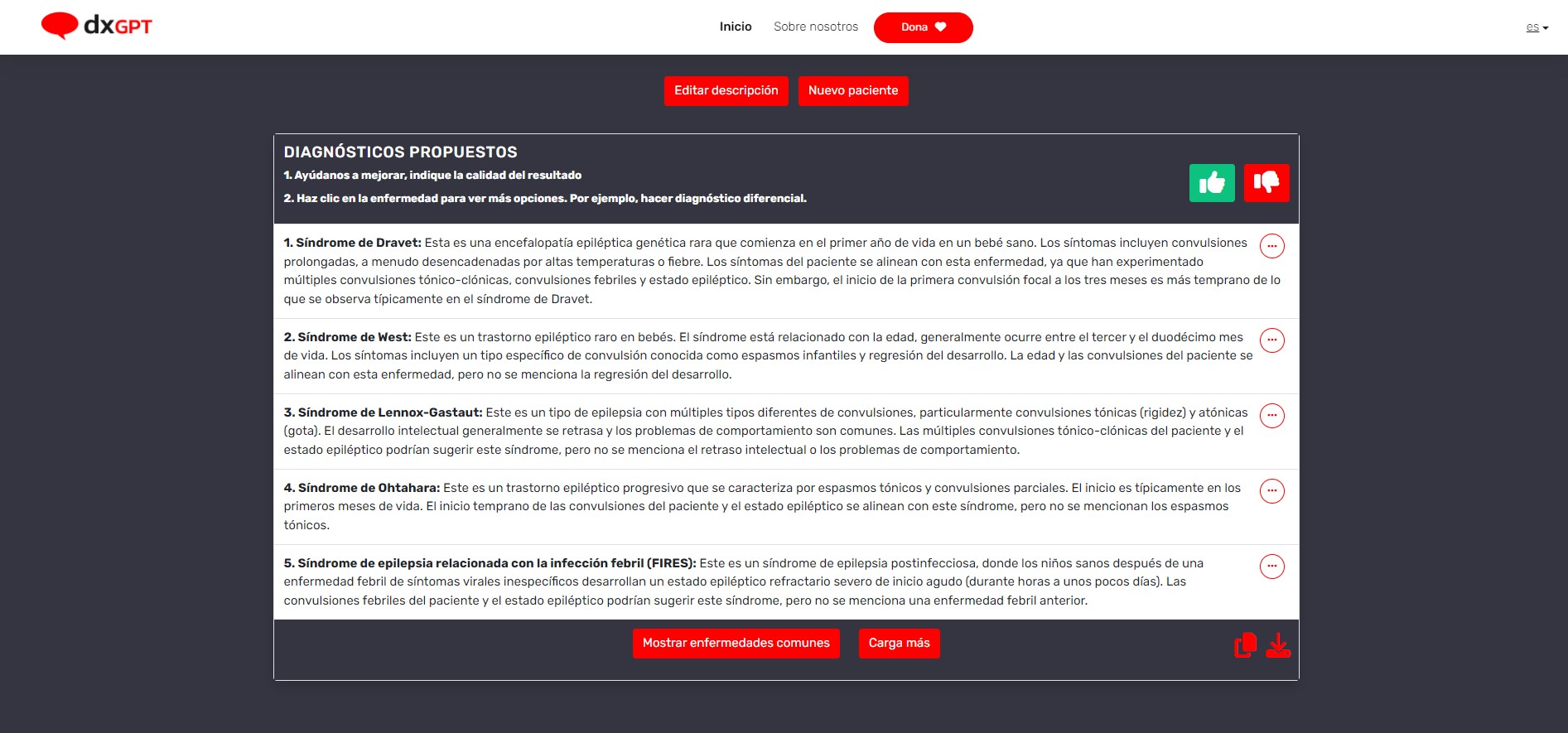

Precisamente, dxGPT se ha creado para evitar esto y, con su integración en el ámbito de la sanidad, esperemos que estos datos sólo vayan a mejor. Gracias a esta herramienta similar a ChatGPT, los médicos podrán introducir una serie de síntomas y la IA les mostrará una lista con los diagnósticos más plausibles.

Pero esto no acaba ahí. Una vez realizada la consulta, los profesionales sanitarios podrán introducir información adicional, como el historial clínico o pruebas de laboratorio, para afinar aún más su diagnóstico. Evidentemente, la decisión final seguirá siendo exclusivamente de los trabajadores humanos, pero con la ayuda de dxGPT podrán orientarse mejor y, por ende, reducir el tiempo del diagnóstico.

La supervisión humana es fundamental

Como ya advierten desde su sitio oficial, “dxGPT es un experimento de investigación”, por lo que delegar por completo las funciones de los médicos en esta herramienta sería un error.

Ya sabemos que, en ocasiones, los modelos de IA generativa se equivocan y experimentan lo que se califica técnicamente como “alucinaciones”. Sin embargo, lo peor es que, aunque lo que estén diciendo sea falso, muchas veces lo afirman con tal convicción que pueden llegar a “engañarnos”. Y, obviamente, esto se hace especialmente peligroso si lo que está en juego es la salud de las personas.

“La herramienta no pretende reemplazar el consejo médico profesional ni respaldar el diagnóstico, la prevención, el seguimiento, la predicción o el tratamiento y nunca debe usarse para hacer juicios de diagnóstico con paciente reales,” indica un avisa nada más entrar en el sitio.

Así que, en definitiva, este chatbot para médicos necesita supervisión de los expertos humanos a la hora de decantarse por un diagnóstico. De hecho, la responsabilidad por su posible mal uso recae por completo en los usuarios. Sus creadores avisan de que “Fundación 29 no se hace responsable de las consecuencias o daños que puedan derivarse de su uso”.

Imagen de tmeier1964 en Pixabay